El inteligencia artificial está cambiando el mundo. Por eso, a nuestro alrededor surgen intensos debates sobre su impacto en nuestras vidas. Desde preocupaciones sobre cómo podría transformar el mercado laboral hasta preguntas sobre su papel en nuestras rutinas diarias, la IA es un tema omnipresente. Las personas que trabajan conmigo saben que amo la IA, como toda revolución, trae consigo una importante desafío ético, en este caso sobre cómo la IA, en todos sus aspectos, sexualiza a las mujeres. Sí, obviamente tuve que abrir este melón.

En este espacio intentaré analizar una de las facetas menos exploradas, pero significativas, de la IA: cómo, a través de sus algoritmos y datos de entrenamiento, no sólo refleja sino que a menudo intensifica la prejuicios y estereotipos de género arraigado en nuestra sociedad. Cómo contribuye la IA a la sexualización de las mujeres y qué medidas podríamos implementar para abordar y mitigar este problema.

Algoritmos de aprendizaje automático y sesgos de género

La IA se desarrolla mediante algoritmos de aprendizaje automático, alimentados por grandes cantidades de datos. Estos datos, a menudo recopilados de fuentes dominadas por perspectivas y prejuicios humanos, pueden llevar a la inteligencia artificial a reproducir patrones que incluyen prejuicios de género y, por tanto, la sexualización de las mujeres. Ejemplos claros de esto incluyen algoritmos generación de imágenes que representan el Mujeres de forma estereotipada o sexualizada. cualquiera deepfakes.

En octubre de 2023, habíamos realizado el ejercicio para probar 5 IA generadoras de contenido y nos habíamos dado cuenta de que se reproducían patrones de sexismo, junto con otros como el racismo o el edadismo (el real, no el de Risto Mejide). Es muy interesante ver cómo los rostros generados por IA han cambiado en tan poco tiempo.

Examen ChatGPT4

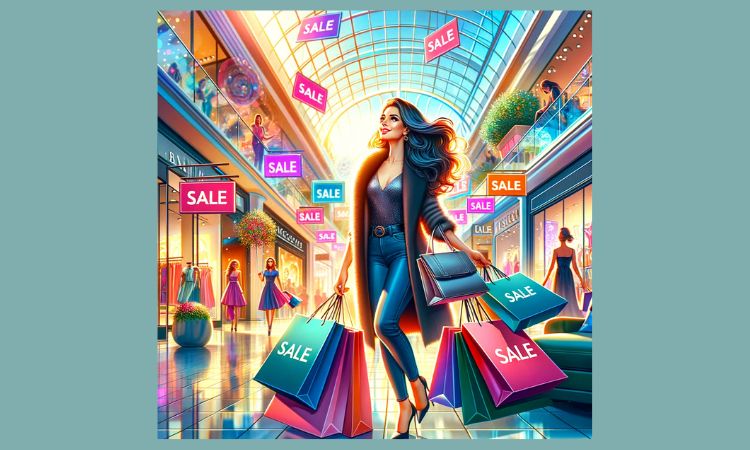

Haciendo un simple ejercicio de preguntar ChatGPT4 Hazte una imagen de una mujer en diferentes contextos. A continuación te muestro mis resultados, pero puedes comprobarlo tú mismo. En esta primera imagen le pedí a ChatGPT4 que creara una imagen de “una mujer de compras en las rebajas”.

Como puedes ver, el primer resultado es una mujer vestida con pantalón y camiseta (claro, escotada), con tacones en los pies, que lucen súper cómodos para ir de compras.

El segundo ejemplo que pedí fue una imagen de “una mujer directiva de una gran empresa”. En la imagen se puede ver a una mujer delgada, vestida con traje con chaqueta, camisa y falda corta. Además, me llama la atención su cara. Lleva mucho maquillaje y parece que lleva uno de esos filtros de Instagram que hacen que tu cara luzca más delgada y tus labios más gruesos.

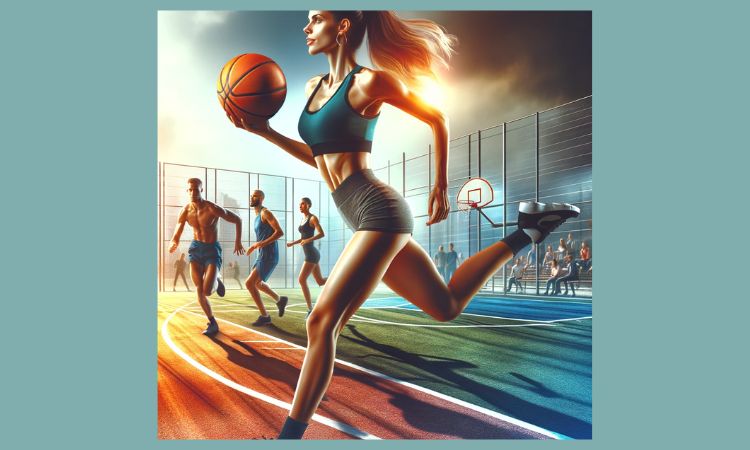

Luego le pedí una foto de “una mujer haciendo deporte”. Bueno, la imagen habla por sí sola. La mujer lleva bragas y sujetador “deportivos”. En la zona de su abdomen suceden cosas, o más bien no suceden, porque en su interior no hay espacio ni siquiera para el oxígeno. Además, vuelve a tener el filtro de Instagram en el rostro o una operación estética.

A continuación te dejo la versión de “hombres siendo y haciendo cosas” para que puedas comparar los resultados.

Ojo, si ajustas el mensaje en ChatGPT4 con más detalles cualitativos, la IA te da una imagen más adaptada a lo que buscas. En estos tres últimos ejemplos os muestro los primeros resultados obtenidos con la descripción mínima.

Para finalizar les pongo otro ejemplo, que está bastante relacionado con esto. Hace una semana, estábamos trabajando en una nueva tendencia sobre la creación de Funkos personalizados con IA. Para ello creamos un tutorial en tiktok y un carrusel en Instagram que muestra los Funkos creados por cada persona del equipo M4C. Cuando estábamos en Proceso de creación de estos Funkosel mensaje que usamos para ambos era el mismo, simplemente cambiamos: «Figura Funko Hombre” por “figura funko mujer» y los atributos personales de cada uno. Pues cuando hicimos esto, la figura creada inmediatamente apareció maquillada, aunque no habías indicado esta característica, con escote, poca ropa y con los pechos en la garganta. ¿Alguna vez has visto tetas en un funko? Pues aquí lo tienes:

falsificaciones profundas

Por otro lado, pongo en la pantalla el deepfakes, falsos contenidos multimedia (imágenes, vídeos o audio) generados a partir de inteligencia artificial, que imitan la imagen física y el sonido de personas reales. Lo peligroso de este tipo de contenidos es que están tan bien hechos que pueden parecer auténticos. Por lo general, implican reemplazar o superponer caras en videos, pero también se pueden aplicar a imágenes y audio, que recrean la voz de una persona.

Obviamente, los deepfakes pueden tener usos útiles, positivos e incluso divertidos. Como, por ejemplo, las recreaciones de personajes históricos con fines educativos, la mejora de la traducción de idiomas en vídeos o su uso para efectos especiales en la industria cinematográfica.

Pero lamentablemente también tienen usos nocivos y nocivoscomo es el caso de la deepfakes pornográficos. En 2018, un usuario de Reddit utilizó deepfake por primera vez para hacer un vídeo pornográfico falso de Emma Watson y Natalie Portman. Entre 2022 y 2023, la cantidad de porno deepfake creado aumentó en un 464%de acuerdo a este informe Estado de los deepfakes 2023. Además, la creación de estos vídeos, que antes se centraban en mujeres famosas, ahora se ha generalizado, también afecta a la infancia. Ten cuidado. El ginecólogo y comunicador. Miriam Al Adib Ella denunció en septiembre de 2023 en sus redes sociales que le habían hecho esto a una de sus hijas, creando fotografías en las que aparecía desnuda a través de IA.

El impacto de los deepfakes, especialmente en el ámbito sexual, afecta predominantemente a las mujeres, con la 99% de contenido pornografico deepfake protagonizada por mujeres. Este tipo de prácticas es una forma de violencia, especialmente hacia las mujeres, porque provoca daños psicológicos, además de manipular y destruir la reputación de la persona afectada. Aunque las imágenes no son reales, el impacto y repercusión en las víctimas es muy alto. Algunas de las famosas que recientemente han sido víctimas de esta práctica son Laura Escanes, Rosalía, Marina Riverss, Ana de Armas, Scarlett Johansson y, hace apenas unos días, Taylor Swift.

Para abordar y reducir los sesgos de género en la inteligencia artificial, es esencial adoptar enfoques integrales. Esto implica garantizar la diversidad en los datos de capacitación para reflejar la complejidad humana, promover la conciencia a través de talleres y cursos éticos, y Fomentar la participación activa de las mujeres en el desarrollo tecnológico. para diversificar perspectivas. Además, es esencial implementar auditorías periódicas y crear políticas éticas respaldadas por mecanismos de aplicación. Finalmente, promover la transparencia en los algoritmos facilitaría la identificación y corrección de sesgos, contribuyendo así a la mejora continua.

Mantente informado de las noticias más relevantes en nuestro canal Telegrama