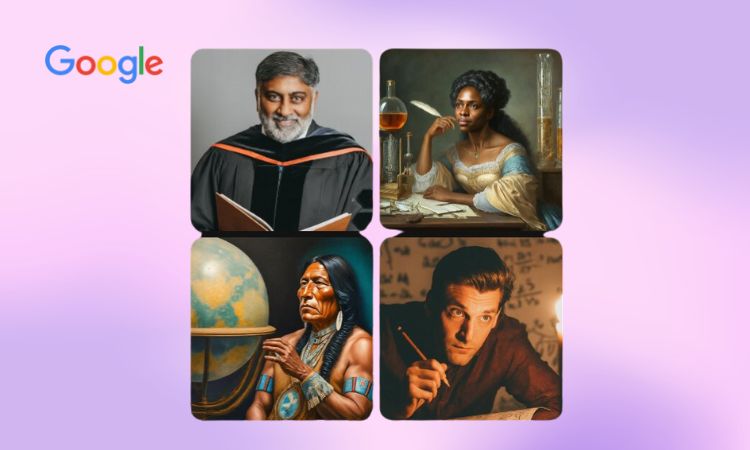

Google ha anunciado que pausará la capacidad de generar imágenes de personas en Geminis (antes Bard) mientras resolvía problemas relacionados con «imprecisiones en algunas representaciones históricas».

Esto ocurre a pocos días de que varios usuarios indicaran a la empresa tecnológica a través de las redes sociales, de mejor o peor manera, que su IA generadora de imágenes estaba recreando personajes históricos o personas correspondientes a periodos pasados específicos incorrectamente.

Esto no está bien. #googlegéminis pic.twitter.com/LFjKbSSaG2

– Juan L. (@JohnLu0x) 20 de febrero de 2024

Google detiene sus capacidades de imágenes de personas

Ayer 21 de febreroGoogle decidió publicar un breve declaración en X con el que calmar las aguas. «Somos conscientes de que Géminis ofrece imprecisiones en algunas representaciones de imágenes históricas.. Estamos trabajando para mejorar este tipo de representaciones de forma inmediata.. Las imágenes de IA de Gemini generan una amplia gama de personajes. Y eso, en general, es algo bueno porque lo usa gente de todo el mundo. Pero aquí no da en el blanco.».

Sin embargo, Parece que esto no ha sido suficiente, ya que hace apenas unas horas la compañía se ha vuelto a expresar en esta red social, pero esta vez para anunciar que desactivarán la función de generación de personas en su herramienta hasta que se solucionen los problemas. «Ya estamos trabajando para solucionar problemas recientes con la función de imágenes de Gemini. Mientras hacemos esto, vamos a pausar la generación de imágenes de personas etcétera publicaremos uno nuevamente Versión mejorada».

Ya estamos trabajando para solucionar problemas recientes con la función de generación de imágenes de Gemini. Mientras hacemos esto, vamos a pausar la generación de imágenes de personas y pronto volveremos a publicar una versión mejorada. https://t.co/SLxYPGoqOZ

— Comunicaciones de Google (@Google_Comms) 22 de febrero de 2024

IA y diversidad, una relación compleja

Si bien algunos usuarios simplemente han señalado las inconsistencias de las obras creadas con Géminis, destacando la importancia de reflejar con precisión los momentos históricos, Otros han aprovechado la viralidad del tema para lanzar mensajes dañinos y racistas..

Está claro que hay una diferencia de intenciones entre los que indican que crear una imagen de un soldado nazi no debería ser el resultado de una persona asiática, y los que se emocionan porque ante la pronta “mujer americana” la IA ofrece imágenes de mujeres negras, de ascendencia asiática o que simplemente no son blancos.

La representación y la diversidad en la IA, como en todos los aspectos de la vida, son importantes. No existe un único tipo de “mujer americana”, y defender que la hay es negar la realidad y negar a todas aquellas mujeres que no responden al modelo que ciertas personas han decidido que es adecuado.

Hace menos de dos años, para detectar la Sesgos de la IA, probamos varias herramientas y pudimos determinar que presentaban sesgos de género, etnia, orientación sexual y edad. Asimismo, hace apenas unos días repetimos el experimento, pero esta vez centrándonos en prejuicios de género y sexualización. Aunque entre un artículo y otro los avances en IA han sido abismales, La diversidad sigue siendo una asignatura pendiente para esta tecnología.

Que los esfuerzos de Google por eliminar el sesgo en su IA hayan conducido a “imprecisiones históricas” debería ser anecdótico. Este es un aspecto que seguramente la tecnología podrá corregir en breve, mientras La intolerancia es un problema que, como está demostrado, nos costará mucho más erradicar..

Mantente informado de las noticias más relevantes en nuestro canal Telegrama